AI lan truyền sai lệch (hallucination) — trách nhiệm thuộc về ai?

Trong thời đại công nghệ phát triển như hiện nay, trí tuệ nhân tạo (AI) đã trở thành một phần không thể thiếu trong cuộc sống hàng ngày của chúng ta. Tuy nhiên, cùng với những lợi ích mà nó mang lại, AI cũng đang đối mặt với một vấn đề lớn: hiện tượng "hallucination" hay còn gọi là lan truyền thông tin sai lệch. Vậy, ai sẽ chịu trách nhiệm khi AI gặp phải tình trạng này? Bài viết này sẽ khám phá sâu hơn về vấn đề AI hallucination, trách nhiệm của các bên liên quan, và những thách thức đạo đức mà chúng ta cần đối mặt. Từ đó, chúng ta sẽ có cái nhìn rõ ràng hơn về cách quản lý và sử dụng AI một cách hiệu quả và an toàn.

AI Hallucination là gì?

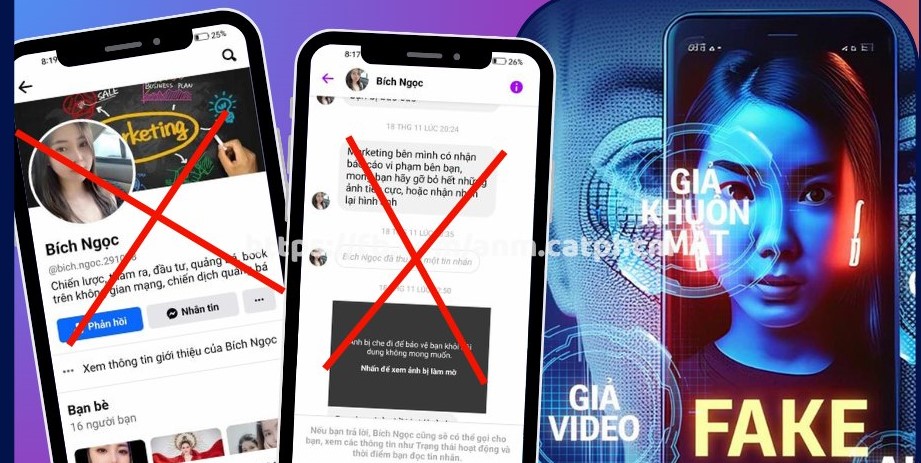

AI hallucination là hiện tượng khi các hệ thống AI tạo ra hoặc lan truyền thông tin không chính xác hoặc hoàn toàn sai lệch. Điều này có thể xảy ra do các thuật toán học máy (machine learning) không được huấn luyện đúng cách hoặc do dữ liệu đầu vào không chính xác. Ví dụ, một hệ thống AI có thể tạo ra một báo cáo tài chính với số liệu không đúng, hoặc một chatbot có thể cung cấp thông tin sai lệch về sức khỏe. Hiện tượng này không chỉ làm giảm hiệu quả của AI mà còn có thể gây ra hậu quả nghiêm trọng cho người dùng và xã hội.

Nguyên nhân dẫn đến AI Hallucination

Có nhiều nguyên nhân dẫn đến hiện tượng AI hallucination. Đầu tiên là do dữ liệu đầu vào không đầy đủ hoặc không chính xác, khiến cho AI không thể học hỏi và đưa ra kết quả chính xác. Thứ hai, các thuật toán học máy có thể gặp lỗi hoặc không được tối ưu hóa tốt, dẫn đến việc tạo ra thông tin sai lệch. Cuối cùng, quá trình kiểm tra và giám sát AI có thể không được thực hiện đầy đủ, dẫn đến việc không phát hiện ra các lỗi sai trước khi chúng được công bố.

Trách nhiệm thuộc về ai?

Vấn đề trách nhiệm trong việc AI lan truyền thông tin sai lệch là một câu hỏi phức tạp và cần được xem xét từ nhiều góc độ khác nhau. Đầu tiên, nhà phát triển AI cần đảm bảo rằng các hệ thống của họ được thiết kế và kiểm tra kỹ lưỡng để giảm thiểu khả năng xảy ra lỗi. Họ cần cung cấp các công cụ và hướng dẫn sử dụng rõ ràng cho người dùng để tránh các tình huống không mong muốn.

Vai trò của người dùng AI

Người dùng AI cũng có trách nhiệm trong việc sử dụng công nghệ này một cách đúng đắn và có ý thức. Họ cần hiểu rõ về các giới hạn của AI và không nên hoàn toàn dựa dẫm vào các thông tin mà AI cung cấp. Việc sử dụng AI cần đi kèm với sự kiểm tra và xác minh thông tin từ nhiều nguồn đáng tin cậy khác.

Đạo đức công nghệ và trách nhiệm xã hội

Đạo đức công nghệ cũng đóng một vai trò quan trọng trong việc quản lý AI hallucination. Các công ty công nghệ cần có trách nhiệm xã hội trong việc phát triển và triển khai AI. Điều này bao gồm việc đảm bảo rằng các sản phẩm AI không gây hại cho xã hội và tuân thủ các tiêu chuẩn đạo đức và pháp lý. Các nhà lập pháp cũng cần đưa ra các quy định rõ ràng về trách nhiệm và quyền lợi của các bên liên quan trong việc sử dụng AI.

Kết luận

AI hallucination là một thách thức lớn trong thời đại công nghệ số, đòi hỏi sự hợp tác và trách nhiệm từ cả nhà phát triển, người dùng và cộng đồng xã hội. Để giải quyết vấn đề này, chúng ta cần có một cách tiếp cận toàn diện, bao gồm việc nâng cao chất lượng dữ liệu, cải thiện thuật toán và tăng cường giám sát. Đồng thời, việc nâng cao nhận thức và giáo dục về AI cũng là một yếu tố quan trọng để đảm bảo rằng công nghệ này được sử dụng một cách an toàn và hiệu quả. Trong tương lai, với sự phát triển không ngừng của AI, việc quản lý và giải quyết vấn đề AI hallucination sẽ tiếp tục là một nhiệm vụ quan trọng đối với toàn xã hội.