Vì sao Microsoft nên lo lắng về MacBook M5

Apple đã nâng tầm trí tuệ nhân tạo cục bộ. Liệu thế giới Windows có thể theo kịp?

Tóm lại:

- PCWorld nhấn mạnh rằng chip M5 Pro và M5 Max mới của Apple trong MacBook Pro đặt ra mối đe dọa đáng kể đối với tham vọng về trí tuệ nhân tạo của Microsoft nhờ khả năng xử lý AI cục bộ vượt trội.

- M5 Max cung cấp bộ nhớ hợp nhất lên đến 128GB, vượt xa các đối thủ như Nvidia RTX 5090 với 32GB, cho phép các mô hình AI lớn chạy cục bộ với quyền riêng tư được nâng cao và độ trễ được giảm thiểu.

- Các bộ tăng tốc thần kinh tích hợp của Apple trong lõi GPU và khung MLX tạo ra một nền tảng AI hiệu quả hơn so với phương pháp học máy (ML) của Microsoft trên Windows.

Máy Mac Mini của Apple đã trở thành lựa chọn hàng đầu để chạy AI cục bộ. Dòng MacBook Pro mới nhất của Apple với chip Apple M5 Pro và Apple M5 Max hứa hẹn sẽ còn thu hút các nhà phát triển hơn nữa.

Tuần này, Apple đã ra mắt dòng MacBook Pro mới , kết hợp hai chip CPU 3nm với một giao tiếp giữa hai chip. Jason Cross của Macworld lưu ý rằng thiết kế hai chip này không phải là mới; các bộ xử lý AMD như Ryzen 9 5950X hoặc 7950X3D cũng sử dụng một cặp chiplet được kết nối bằng giao tiếp Infinity Fabric của hãng.

Điểm mới của chip M5 của Apple là việc tích hợp “lõi siêu xử lý” và “lõi hiệu năng cao”. Một số thành phần – được đổi tên thành “lõi siêu xử lý” – chỉ là cách đặt tên thương hiệu, như Jason đã chỉ ra. Các thành phần khác, như lõi hiệu năng cao mới, vẫn còn khá bí ẩn. Nhưng điều thực sự thú vị là chúng được kết hợp với GPU từ 20 đến 40 lõi, mỗi GPU đều có bộ tăng tốc thần kinh bên trong, cũng như bộ nhớ hợp nhất có thể cấu hình lên đến 128GB. Đó là điều mà máy tính Windows của bạn không có, và mang lại cho khách hàng của Apple một số lợi thế.

Hiện tại, chúng ta chưa biết một số chi tiết xung quanh những con chip mới nhất của Apple mà một bài phân tích chuyên sâu có thể tiết lộ, có lẽ tại hội nghị chip Hot Chips vào tháng 8 này. Nhưng chỉ cần nhìn tổng quan thôi cũng đủ để chúng ta phải trầm trồ trước những gì Apple đang làm.

Bộ nhớ rất quan trọng, và dòng MacBook M5 Max đáp ứng điều đó một cách xuất sắc.

Hãy cùng bàn ngay về khía cạnh ấn tượng nhất: bộ nhớ. Chip M5 Max của Apple bao gồm bộ nhớ hợp nhất tiêu chuẩn 48GB, có thể nâng cấp lên đến 128GB. Trang cấu hình của Apple hơi khó hiểu, nhưng dường như tất cả các dòng MacBook Pro 16 inch đều có thể cấu hình với dung lượng đó, mặc dù với mức giá lên tới 4.399 đô la. Nhưng đó chỉ là cấu hình bộ nhớ hợp nhất.

Trong nhiều năm, các máy tính xách tay chạy Windows sử dụng chip AMD và Intel đều có VRAM chuyên dụng: một nửa dung lượng RAM hệ thống khả dụng trên máy tính xách tay Intel, và một phiên bản cố định trên máy tính xách tay Ryzen. Khi AMD công bố bộ xử lý Ryzen AI Max dành cho AI cục bộ, họ đã tinh chỉnh phần mềm Adrenalin để cho phép người dùng điều chỉnh VRAM ngay lập tức. Tháng 8 năm ngoái, Intel đã ra mắt tính năng “Ghi đè bộ nhớ GPU dùng chung”, về cơ bản cũng làm điều tương tự. Qualcomm, với các bộ xử lý Arm có kiến trúc gần giống nhất với M5 Pro và Max, lại không cung cấp khả năng này.

Dĩ nhiên, MacBook của Apple có thể được sử dụng cho nhiều mục đích hơn là chỉ trí tuệ nhân tạo, ví dụ như dò tia (ray tracing).

Chip M5 của Apple sử dụng cái mà hãng gọi là MLX, một khung mảng mã nguồn mở dường như đưa trí tuệ nhân tạo cục bộ lên một tầm cao mới. Theo giải thích của Apple , MLX không yêu cầu người dùng phải tự tính toán lượng bộ nhớ cần phân bổ. Nó thậm chí không nhất thiết phải tự đưa ra lựa chọn đó. Thay vào đó, MLX, được tích hợp hỗ trợ huấn luyện và suy luận mạng thần kinh, bao gồm cả tạo văn bản và hình ảnh, có thể “chạy trên CPU hoặc GPU mà không cần phải di chuyển bộ nhớ”. Nói một cách dễ hiểu, nó hoạt động trơn tru.

Các mô hình AI ngốn phần lớn bộ nhớ nhanh nhất có sẵn trên máy tính của bạn, thường là bộ nhớ video liên kết với GPU. Các mô hình AI tốt nhất thường là phức tạp nhất: càng lớn càng tốt, và các mô hình AI sử dụng số lượng tham số làm thước đo chung về hiệu quả của chúng. Nhưng những mô hình đó cũng cần rất nhiều bộ nhớ để hoạt động — giống như Windows sẽ không chạy trên máy tính chỉ có 2GB RAM, và đó là lý do tại sao Adobe Photoshop yêu cầu nhiều hơn đáng kể.

Tóm lại: MacBook Pro M5 mới của Apple có bộ nhớ khả dụng lên đến 128GB, phần lớn trong số đó dành cho GPU — trong trường hợp này là bộ xử lý AI. Con số này cao hơn nhiều so với VRAM cục bộ của card đồ họa PC mạnh nhất hiện nay, Nvidia RTX 5090, vốn chỉ có 32GB VRAM. Và nếu bạn nghĩ rằng 4.399 đô la là quá nhiều để trả cho một thiết bị AI, thì MacBook Pro giá 3.099 đô la cũng bao gồm 48GB bộ nhớ hợp nhất theo tiêu chuẩn. Bạn hiểu ý tôi chứ.

Như vậy, MacBook của Apple sẽ có khả năng tải và chạy các mô hình AI cục bộ mà thông thường phải chạy trên đám mây. Điều đó có nghĩa là không có độ trễ, không có chi phí đăng ký, không có dữ liệu nào rời khỏi thiết bị cho các ứng dụng bị chi phối bởi luật bảo mật nghiêm ngặt. Ước tính của Apple (bên dưới) cho thấy sự so sánh bộ nhớ của nhiều mô hình phổ biến khác nhau, và chúng sẽ dễ dàng chạy trên MacBook. Tăng gấp đôi dung lượng bộ nhớ được phân bổ trên mô hình Qwen3, và một mô hình 70 tỷ tham số sẽ khả thi. Thậm chí còn tuyệt vời hơn, Apple đã công bố một vài dòng mã để lượng tử hóa, hay nén, một mô hình xuống độ chính xác thấp hơn. Thật ấn tượng.

Nhưng thiết kế của Apple cũng có một số đặc điểm hiệu năng ấn tượng. Các bộ xử lý từ AMD, Intel và Qualcomm đều bao gồm một GPU chuyên dụng, thống nhất. Apple thì không: thay vào đó, họ đặt một NPU (hoặc ít nhất là một "bộ tăng tốc thần kinh") bên trong mỗi lõi GPU của mình. Chúng ta biết rằng các bộ tăng tốc thần kinh này thực hiện các phép nhân ma trận chuyên dụng cần thiết cho máy học, và Apple cũng có một bộ xử lý thần kinh 16 lõi riêng biệt mà họ cho là tên gọi của một NPU chuyên dụng. Chúng ta thực sự không biết tất cả chúng tương tác với nhau như thế nào.

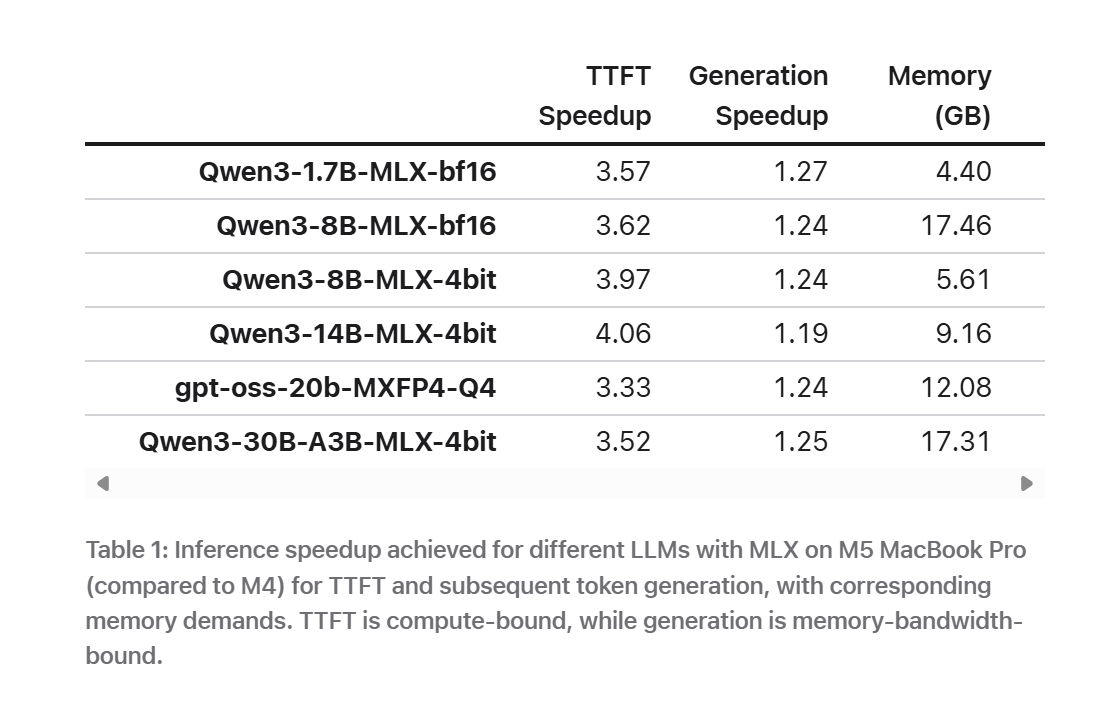

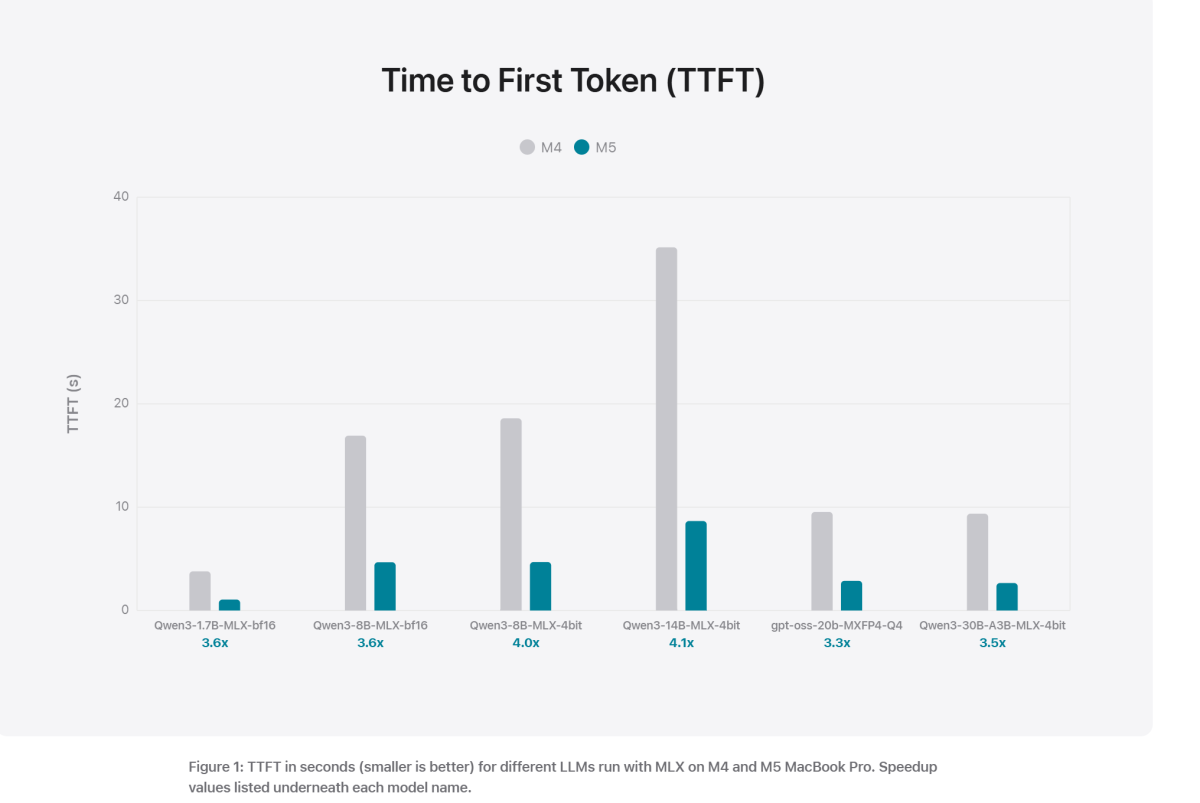

Tuy nhiên, Apple cho biết “thời gian phản hồi đầu tiên” (tốc độ LLM phản hồi đầu vào của bạn) nhanh hơn đáng kể, cả trong bảng trên và biểu đồ bên dưới.

Cá nhân tôi, việc sử dụng LLM không thực sự bị giới hạn bởi tốc độ của LLM. Tôi thích phản hồi nhanh, nhưng cách tạo văn bản giống như máy in ma trận điểm của LLM có thể khiến việc đọc trở nên khó khăn. Độ tinh tế của phản hồi quan trọng hơn.

Liệu thế giới Windows có thể theo kịp?

Công bằng mà nói, Microsoft cũng đang phát triển một thứ tương tự: Windows ML , tận dụng sức mạnh xử lý cao nhất hiện có trên PC để chạy các ứng dụng AI cục bộ. Về cơ bản, nó nói rằng bạn không cần NPU, chỉ cần bất kỳ thành phần mạnh nhất hiện có trong PC của bạn. Phương pháp nào tốt hơn? Thành thật mà nói, tôi không biết, mặc dù việc thử nghiệm đúng cách sẽ cho ra câu trả lời.

Bộ xử lý Ryzen AI Max+ của AMD là một cỗ máy mạnh mẽ về trí tuệ nhân tạo, và có lẽ là đối thủ cạnh tranh gần nhất của Apple. AMD trang bị 80MB bộ nhớ đệm để giải quyết vấn đề trí tuệ nhân tạo với AI Max+ 395, và việc tăng dung lượng bộ nhớ cho bộ xử lý là một chiến lược mà hãng đã sử dụng rất hiệu quả.

Tuy nhiên, tôi đã thấy một số báo cáo không chính thức cho rằng nhân viên Apple Store đã rất ngạc nhiên trước việc Mac Mini bán chạy như tôm tươi. Nhưng những chiếc máy nhỏ gọn này đã chứng tỏ rất hữu ích cho các nhà phát triển muốn chạy LLM hoặc AI tác nhân cục bộ, mà không cần tiêu tốn quá nhiều năng lượng hoặc phí đăng ký AI. MacBook Pro mới của Apple chỉ đơn giản là thêm một màn hình.

Tuy nhiên, theo như tôi thấy, Mac Mini không được thiết kế dành cho trí tuệ nhân tạo (AI). Giờ đây, ban lãnh đạo Apple đã nhận thức được rằng Mac Mini là thiết bị được ưa chuộng cho AI, vì vậy sẽ rất thú vị để xem điều gì sẽ xảy ra với chiếc Mac Mini dự kiến ra mắt năm 2026 với chip M5 bên trong . Điều này chắc chắn đặt ra một tiêu chuẩn rất cao cho AMD, Intel và Qualcomm.