Các mối đe dọa AI sẽ còn tồi tệ hơn: 6 cách để sánh ngang với sự lì lợm của kẻ thù kỹ thuật số

Đừng đợi đến khi deepfake và mã độc do AI hỗ trợ làm tê liệt tổ chức của bạn. Các chuyên gia khuyến nghị những biện pháp quyết liệt sau để củng cố hệ thống phòng thủ.

Những điểm chính

AI càng mạnh, tác nhân đe dọa càng khai thác nó để tấn công.

Tổ chức và cá nhân phải sánh ngang với mức độ lì lợm của đối thủ.

Chuyên gia khuyến nghị các thực hành tốt nhất để tránh thảm họa.

Lần gần đây nhất bạn tự hỏi liệu cuộc gọi lạ tắt máy ngay sau khi bạn nói “alo” có ghi lại giọng nói của bạn để dùng vào mục đích xấu là khi nào? Ủy ban Truyền thông Liên bang Mỹ (FCC) đã cảnh báo về các chiêu trò như vậy gần một thập kỷ trước, khi AI còn chưa phổ biến.

Giờ đây — với AI có thể sao chép giọng nói và tông hội thoại của bạn chỉ từ ba giây âm thanh — mức độ rủi ro đã cao hơn nhiều.

Dù được dùng cho mục đích hợp pháp hay xấu xa, điểm bán hàng lớn nhất của AI luôn là tốc độ và khả năng mở rộng. Trong tay kẻ tấn công, thiệt hại có thể xảy ra trong chớp mắt. Và tình hình đang xấu đi. Phản ứng duy nhất có ý nghĩa là phải ngang tầm sự lì lợm của đối thủ.

Tác nhân đe dọa đang nhanh chóng thích nghi AI vào chiến thuật của họ

Báo cáo tháng 1/2025 của Google Threat Intelligence Group (GTIG) cho thấy ban đầu các nhóm tấn công chủ yếu dùng Gemini cho các tác vụ năng suất cơ bản.

Tuy nhiên, đến tháng 11/2025, GTIG ghi nhận sự tiến hóa đáng kể:

“Kẻ tấn công không còn chỉ dùng AI để tăng năng suất; họ triển khai mã độc hỗ trợ AI có khả năng thay đổi hành vi trong lúc thực thi.”

Anthropic cũng báo cáo rằng Claude bị lợi dụng cho các chiến dịch thao túng thông tin, trong đó AI không chỉ tạo nội dung mà còn quyết định thời điểm bot mạng xã hội bình luận, thích hoặc chia sẻ bài viết.

Anthropic cũng phát hiện các chiến dịch stuffing thông tin xác thực, lừa đảo tuyển dụng và cả những kẻ mới vào nghề dùng AI để nâng cao kỹ năng viết mã độc vượt quá trình độ của họ.

Sự tiến hóa không thể ngăn cản của deepfake

Mối đe dọa đáng lo nhất hiện nay là deepfake video, hình ảnh và âm thanh ngày càng thuyết phục.

Ví dụ, mô hình Seedance 2.0 của ByteDance đã tạo ra cảnh Tom Cruise đánh nhau với Brad Pitt cực kỳ chân thực chỉ từ một prompt hai dòng — gây phản ứng dữ dội từ ngành giải trí.

Theo Alex Cox (LastPass), chúng ta đang tiến đến điểm mà AI có thể giả mạo gần như hoàn toàn mọi hình thức tương tác trực tuyến.

Viết vẫn là thế mạnh nhất của AI. Nhưng video và âm thanh đang tiến rất gần.

Cox dự đoán sớm muộn gì chúng ta cũng có thể bị đánh lừa trong một cuộc họp video — nghĩ rằng mình đang nói chuyện với người thật, trong khi đó là deepfake.

Hãy tưởng tượng kẻ tấn công tạo avatar ảo giống hệt lãnh đạo công ty bạn — từ giọng nói, cử chỉ, địa điểm xuất hiện quen thuộc — và “trở thành” họ trong cuộc họp.

Hiện tại vẫn còn độ trễ và lỗi nhỏ. Nhưng sự ngang bằng đang đến rất nhanh.

Văn bản và hình ảnh tĩnh: đã là “trận chiến thua”?

Hai năm trước, Sports Illustrated và TheStreet từng đăng bài viết do “tác giả AI giả mạo” tạo ra.

Vấn đề không chỉ là tội phạm mạng — mà là sự gia tăng của hành vi lừa dối có chủ đích và danh tính không xác thực trên mạng.

Khi bạn đã bị dụ bởi deepfake, thiệt hại là gì?

Bạn có chuyển tiền vì tin vào giọng nói giả không?

Bạn có bị lừa cung cấp thông tin đăng nhập không?

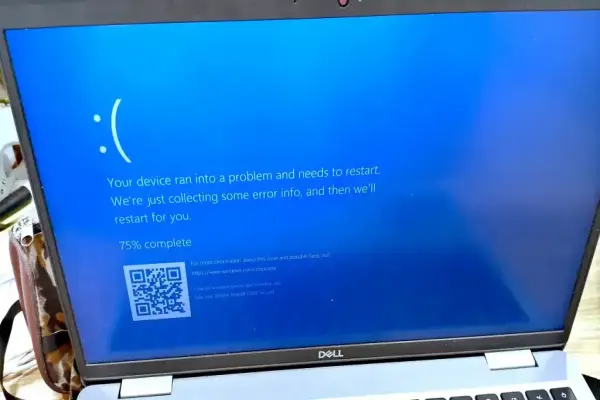

Thiết bị của bạn có bị nhiễm mã độc xâm nhập hệ thống công ty?

Agent AI độc hại có thể chạy tự do sau tường lửa?

6 cách tự bảo vệ — bắt đầu ngay bây giờ

1. Cập nhật liên tục về mối đe dọa

Theo dõi sát các nguồn uy tín như Anthropic, Google DeepMind, OpenAI, GTIG, CISA, OWASP LLM Top Ten, AI Incident Database và Mitre ATT&CK.

Hiểu rõ bối cảnh rủi ro là nền tảng của phòng thủ.

2. Chuyển sang thông tin xác thực không thể bị phishing

Áp dụng passkeys và MFA dạng number-matching.

Phần lớn tấn công bắt đầu từ phishing hoặc vishing (lừa đảo bằng giọng nói). AI sẽ khiến chúng thuyết phục hơn.

Mật khẩu và OTP qua SMS/email ngày càng kém an toàn.

3. Xác định toàn bộ agent

Trước khi triển khai AI agent, hãy đảm bảo bạn có thể nhận diện và quản lý từng agent hợp pháp.

Sử dụng hệ thống IAM như Microsoft, Okta, Ping Identity để quản lý danh tính agent như quản lý nhân viên.

Agent hợp pháp có thể trở thành mục tiêu hấp dẫn của agent độc hại.

Nếu không có khả năng thu hồi nhanh quyền truy cập, thiệt hại sẽ lan rộng.

4. Áp dụng Zero Trust

Không tin mặc định bất kỳ ai hay bất kỳ agent nào.

Cấp quyền tối thiểu ban đầu và chỉ mở rộng khi cần thiết.

Tin tưởng phải được chứng minh — không phải mặc định.

5. Kiểm soát OAuth token

Bạn có thể đã cấp nhiều OAuth token cho các dịch vụ truy cập thay mặt bạn.

Khi agent AI bùng nổ, số lượng token sẽ tăng vọt.

Bạn có biết tất cả token đã cấp?

Bạn có biết cách thu hồi chúng?

OAuth token là mục tiêu rất giá trị đối với kẻ tấn công.

6. Giữ sự hoài nghi

Ngày càng khó phân biệt thật – giả.

Tuần trước, chỉ vài giờ sau khi Hillary Clinton phủ nhận gặp Jeffrey Epstein, deepfake hình ảnh bà cùng Epstein đã lan truyền.

Deepfake sẽ được dùng theo cách không thể đoán trước.

Nếu bạn nhận được video hay tin nhắn giọng nói từ CEO yêu cầu hành động bất thường — hãy xác minh lại.

Luôn kiểm tra tính xác thực.

Hiểu rõ kẻ thù

Hãy đặt mình vào vị trí kẻ tấn công.

Nếu bạn là họ, bạn sẽ khai thác mọi khả năng AI để đạt mục tiêu.

AI càng mạnh, nạn nhân càng dễ bị tổn thương.

Giống như mang súng vào cuộc đấu dao.

Giờ bạn đã biết điều đó. Bạn sẽ để kết quả cho may rủi hay chủ động nâng cấp phòng thủ?

Và về những cuộc gọi lạ chỉ chờ bạn nói “alo” rồi tắt máy — có lẽ bạn nên cân nhắc không nghe số lạ (hoặc ít nhất đợi họ nói trước).

Khó chịu? Có thể.

Nhưng hãy nhớ nguyên tắc zero trust:

Nếu cuộc gọi thực sự quan trọng và hợp pháp, họ sẽ tìm cách liên hệ lại.