Cái bẫy mà Anthropic tự giăng ra cho chính mình.

Trong nhiều năm, các công ty AI hàng đầu — bao gồm Anthropic>, OpenAI và Google DeepMind — đã theo đuổi một chiến lược quen thuộc: cam kết tự điều chỉnh, tự xây dựng tiêu chuẩn an toàn thay vì ủng hộ các quy định pháp lý ràng buộc từ bên ngoài.

Tuy nhiên, theo bài phân tích của TechCrunch>, chính chiến lược này đang đặt Anthropic vào một tình thế khó khăn khi công ty vướng vào tranh cãi với Bộ Quốc phòng Hoa Kỳ>.

Chiến lược “tự điều chỉnh” và hệ quả

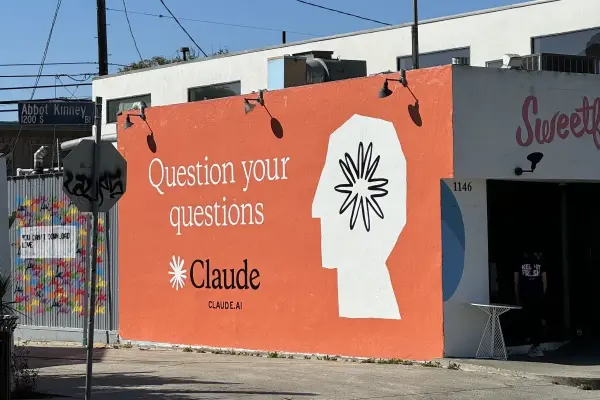

Ngay từ khi thành lập, Anthropic xây dựng hình ảnh là một công ty AI tập trung mạnh vào an toàn và đạo đức. Họ thường nhấn mạnh rằng các mô hình như Claude sẽ không bị sử dụng cho:

Giám sát hàng loạt

Ứng dụng quân sự gây tranh cãi

Các mục đích có nguy cơ gây hại xã hội

Tuy nhiên, việc tự đặt ra các giới hạn này lại trở thành điểm xung đột khi làm việc với chính phủ.

Nếu không có một khung pháp lý rõ ràng từ bên ngoài, những cam kết nội bộ của doanh nghiệp có thể va chạm trực tiếp với yêu cầu từ các cơ quan nhà nước.

Tranh cãi với Lầu Năm Góc

Căng thẳng leo thang khi Anthropic từ chối chấp nhận một số điều khoản liên quan đến việc sử dụng AI trong bối cảnh quốc phòng. Phản ứng lại, chính quyền Mỹ được cho là đã có động thái hạn chế hoặc ngừng sử dụng sản phẩm của công ty trong một số cơ quan liên bang.

Trong khi đó, các đối thủ như OpenAI được cho là đạt được thỏa thuận riêng với Bộ Quốc phòng, với những điều khoản bảo đảm khác.

Điều này đặt Anthropic vào thế khó:

Nếu giữ vững cam kết đạo đức → có nguy cơ mất hợp đồng chính phủ

Nếu nhượng bộ → ảnh hưởng đến hình ảnh và triết lý ban đầu

“Cái bẫy” mà ngành AI tự tạo

Theo phân tích trong bài viết, vấn đề không chỉ nằm ở Anthropic mà còn ở toàn bộ ngành AI.

Trong nhiều năm, các công ty công nghệ lớn đã vận động hành lang để tránh các quy định quá nghiêm ngặt, với lập luận rằng:

Đổi mới cần linh hoạt

Tự điều chỉnh hiệu quả hơn luật cứng nhắc

Tuy nhiên, khi xảy ra xung đột với chính phủ — đặc biệt trong các vấn đề an ninh quốc gia — việc thiếu một khung pháp lý rõ ràng khiến các công ty không có “lá chắn” pháp lý để bảo vệ quan điểm của mình.

Nói cách khác, họ đã tự tạo ra một môi trường nơi:

Không có luật rõ ràng bảo vệ nguyên tắc đạo đức

Nhưng chính phủ vẫn có thể áp đặt yêu cầu mạnh mẽ

Đó chính là “cái bẫy”.

Tác động rộng hơn

Trường hợp của Anthropic cho thấy một câu hỏi lớn đối với ngành AI:

Liệu tự điều chỉnh có đủ để cân bằng giữa đổi mới và trách nhiệm, hay cuối cùng các công ty vẫn phải chấp nhận một hệ thống quy định chính thức?

Khi AI ngày càng gắn với quốc phòng, an ninh và địa chính trị, câu hỏi này sẽ trở nên cấp thiết hơn.